تحيز ChatGPT ونظرة وادي السيليكون: ماذا تعني للمستخدم العربي؟

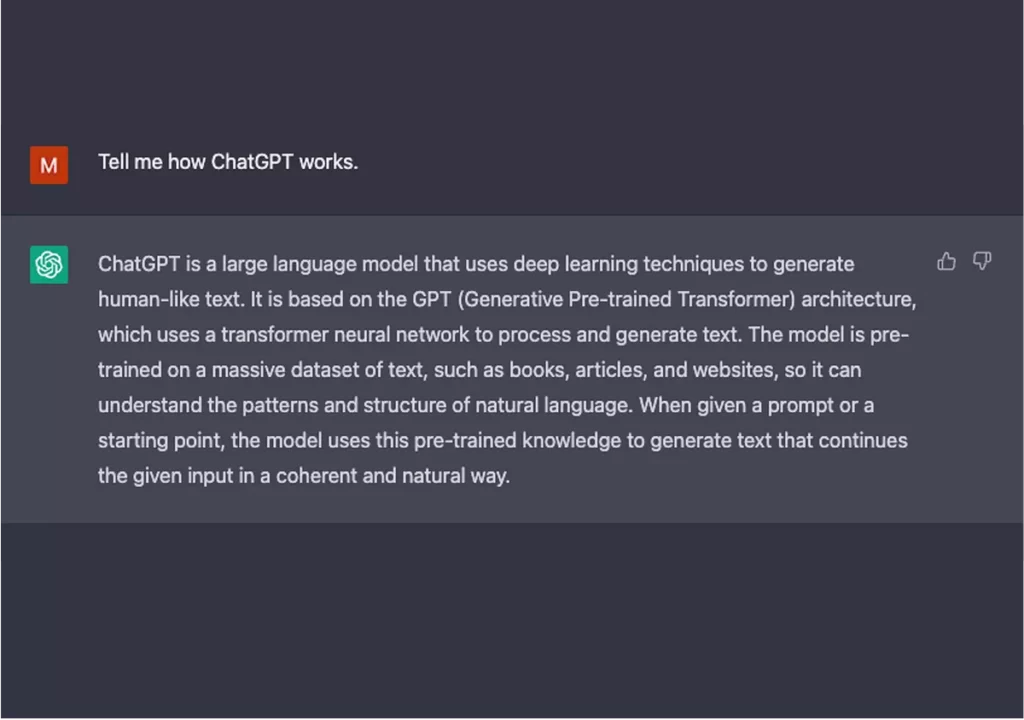

عندما تسأل روبوت محادثة سؤالًا بسيطًا مثل: «أين يعيش الناس الأكثر سعادة؟» قد تتوقع إجابة خفيفة أو مقارنة عامة، لكن ما لا يراه كثيرون أن صياغة الإجابة نفسها قد تحمل منظورًا منحازًا دون قصد. هنا تظهر قضية تحيز ChatGPT التي صارت موضوعًا بحثيًا جادًا، لأنها لا تتعلق برأي شخص واحد، بل بطريقة تعلم النظام من البيانات ومن أولويات من يصنعه.

الفكرة الأساسية أن الذكاء الاصطناعي لا يعيش خارج الواقع الاجتماعي، بل يعكسه ويعيد إنتاجه أحيانًا. وإذا كانت بيانات التدريب وطرق التقييم قادمة غالبًا من بيئات غربية، فقد تظهر «أفضلية» للدول الغنية أو الأكثر حضورًا في الإنترنت، بينما تتراجع دول أخرى في التصنيفات أو تُذكر بصورة أقل ثراءً وتفصيلًا. هذا ما يجعل فهم التحيز مهمًا، ليس لإدانة التقنية، بل لتعلم كيفية استخدامها بوعي أكبر.

ما المقصود بتحيز ChatGPT؟

تحيز ChatGPT لا يعني أنه “يتعمد” التمييز، بل يعني أن الإجابات قد تميل إلى تفضيل منظور شائع في البيانات التي تعلم منها. عندما تكون بعض الدول أو الثقافات ممثلة أكثر في المحتوى الرقمي، تصبح الأمثلة عنها أكثر كثافة، فتبدو الإجابة وكأنها “تؤكد” تفوقها أو تنسب لها صفات إيجابية أكثر، بينما تُختزل مجتمعات أخرى في عبارات عامة أو صور نمطية.

كما يظهر التحيز في نوع الأسئلة نفسها. الأسئلة الذاتية التي تقارن بين الشعوب مثل «الأجمل» أو «الأذكى» تُجبر النظام على تعميمات لا يمكن أن تكون عادلة علميًا، فتتحول الإجابة إلى خليط من الانطباعات الشائعة وسرديات الإعلام وما هو متاح من بيانات، بدلًا من قياس حقيقي. لذلك، التعامل مع مثل هذه الإجابات يجب أن يكون بحذر شديد.

لماذا تُسمى المشكلة “نظرة وادي السيليكون”؟

يستخدم بعض الباحثين تعبير “نظرة وادي السيليكون” لوصف منظور عالمي يتشكل وفقًا لأولويات شركات التقنية الكبرى وبيئاتها وثقافة العمل فيها. هذا المنظور يركز على الابتكار والتكنولوجيا والاقتصاد الرقمي كمعايير رئيسية للحكم على الدول والمجتمعات، فيبدو العالم وكأنه منافسة على “من الأكثر تقدمًا” وفق مقاييس محددة مسبقًا.

عندما تُهيمن مقاييس مثل عدد الشركات الناشئة أو حجم المحتوى الإنجليزي أو قوة حضور الجامعات الغربية، يصبح من السهل أن تظهر دول بعينها في المراتب الأولى باستمرار. وفي المقابل، قد تُهمش مناطق كاملة لأن نشاطها الثقافي أو العلمي أقل توثيقًا على الإنترنت، أو لأنه مكتوب بلغات ليست واسعة الانتشار داخل بيانات التدريب.

كيف تظهر التحيزات في الأسئلة اليومية؟

قد تظن أن التحيز يظهر فقط في السياسة أو الهويات، لكنه قد يظهر أيضًا في أسئلة تبدو “خفيفة”. مثلًا، عند سؤال النموذج عن “أكثر الشعوب أناقة” أو “أكثر الدول إبداعًا”، قد تتكرر أسماء دول معينة، ليس لأنها الأفضل فعليًا، بل لأن سرديات الإعلام والبيانات الرقمية ركزت عليها لسنوات، أو لأن المحتوى المتاح عنها أكثر تفصيلًا.

كذلك قد يظهر التحيز في أسئلة عملية مثل: ترشيح وظائف، كتابة سيرة ذاتية، أو تقييم فرصة قبول بمنحة. إذا كانت الأمثلة المتاحة للنموذج عن سوق عمل معين أكثر كثافة، فقد تكون توصياته مناسبة جدًا لذلك السوق، لكنها أقل دقة عند تطبيقها على سوق محلي مختلف. هذا لا يعني أن الإجابة “خاطئة”، بل أنها قد تكون “غير مناسبة للسياق”.

لماذا دول الجنوب العالمي تتأثر أكثر؟

المشكلة ليست في قيمة المجتمعات، بل في “حجم حضورها الرقمي” وتنوع مصادر المعلومات عنها. عندما تكون البيانات المتاحة عن دولة ما أقل، فإن إجابات النظام قد تصبح أقل تفصيلًا، أو تعتمد على مصادر عامة قديمة، أو تكرر صورًا نمطية متداولة. هنا يصبح التحيز أشبه بفجوة معلومات أكثر منه حكمًا مباشرًا.

هذا يفسر لماذا قد تحصل دول أوروبا الغربية والولايات المتحدة وأجزاء من شرق آسيا على وصف مفصل وعناوين متعددة، بينما تحصل مناطق أخرى على عبارات مختصرة. في الاستخدام اليومي، قد يتحول ذلك إلى شعور بأن الذكاء الاصطناعي “يتجاهل” دولًا أو يقلل من شأنها، بينما الواقع أن البيانات المتاحة هي التي تقود حجم التفصيل وتنوع الأمثلة.

تأثير تحيز ChatGPT على الصحة والتوظيف والتعليم

تزداد حساسية الموضوع عندما يدخل الذكاء الاصطناعي في قرارات تمس حياة الناس. في الصحة مثلًا، إذا كانت بيانات التدريب تميل لعيّنات طبية من دول معينة أو مجموعات عرقية معينة، فقد تكون التوصيات العامة أقل دقة لفئات أخرى. وفي التوظيف، قد تؤثر التحيزات اللغوية والثقافية على أسلوب كتابة الرسائل أو تقييم المهارات “المفضلة” في سوق عمل عالمي معين.

أما في التعليم، فقد يرشح النموذج مصادر ودورات ومراجع تتناسب مع مناهج غربية، بينما يحتاج الطالب في بيئة عربية إلى مراجع محلية أو طرق شرح مختلفة. لذلك، الاستخدام الواعي يعني دائمًا وضع “سؤال السياق”: هل هذه الإجابة مصممة لبيئتي أم لبيئة أخرى؟

كيف تتعامل بذكاء مع الإجابات المتحيزة؟

أفضل طريقة للتعامل مع تحيز ChatGPT هي تغيير طريقة السؤال قبل تغيير الحكم على الإجابة. بدلًا من سؤال: «من الأفضل؟» اسأل: «ما المعايير؟» و«اعرض أكثر من وجهة نظر» و«اذكر القيود والافتراضات». بهذه الطريقة تُجبر النظام على توضيح الأساس، بدل إطلاق حكم عام قد يعكس الصور النمطية أو نقص البيانات.

ومن المفيد أيضًا طلب أمثلة من مناطق مختلفة: «أعطني أمثلة من الشرق الأوسط وأفريقيا وأمريكا اللاتينية»، أو طلب مراجع متنوعة بلغات مختلفة إن أمكن. كلما كانت صياغة الطلب محددة، قلّت احتمالات أن يعود النموذج للإجابات “الافتراضية” التي تركز على الدول الأكثر حضورًا في البيانات.

قائمة أسئلة جاهزة تقلل التحيز

إذا كنت تستخدم الذكاء الاصطناعي في كتابة محتوى أو اتخاذ قرار، جرّب إضافة جملة واحدة في نهاية سؤالك، مثل: «تجنب الصور النمطية واذكر حدود المعلومات». هذه الإضافة تغير شكل الإجابة بالكامل، لأنها تطلب منه الالتزام بالحذر والشرح بدل التعميم. وفي موقع «كله لك» نعتبر هذا الأسلوب مهمًا للحفاظ على محتوى متوازن وقابل للثقة.

- اذكر المعايير التي تبني عليها إجابتك ولا تستخدم أحكامًا مطلقة.

- اعرض 3 وجهات نظر مختلفة لنفس السؤال.

- قارن بين دول متعددة مع توضيح اختلاف البيانات المتاحة لكل دولة.

- إذا كانت المعلومات غير كافية، اذكر ذلك بوضوح بدل التخمين.

- قدّم بدائل أو أمثلة من مناطق أقل تمثيلًا رقميًا.

جدول يوضح أنواع التحيز وكيف تكتشفها بسرعة

أحيانًا لا تحتاج لقراءة طويلة لتكتشف المشكلة، بل لمؤشرات سريعة. الجدول التالي يساعدك على ملاحظة نوع التحيز في الإجابة، ثم تعديل السؤال أو طلب توضيح قبل الاعتماد عليها. الهدف ليس اصطياد الأخطاء، بل تحسين جودة المخرجات لتصبح أكثر عدلًا وملاءمة.

| نوع التحيز المحتمل | كيف يظهر في الإجابة؟ | ماذا تفعل فورًا؟ |

|---|---|---|

| تحيز البيانات | تفصيل كبير عن دول محددة وعمومية عن دول أخرى | اطلب أمثلة متوازنة من مناطق متعددة واذكر نقص البيانات |

| تحيز لغوي | أفضلية للمصادر الإنجليزية أو تجاهل محتوى بلغات أخرى | اطلب مصادر عربية/محلية أو مقارنة بين لغتين |

| تحيز الصور النمطية | تعميمات مثل “الشعب الأكثر…” دون قياس واضح | اطلب معايير وقيود وامتنع عن الأسئلة التصنيفية |

| تحيز سياقي | نصائح وظيفية/تعليمية مناسبة لسوق مختلف عن بلدك | حدد البلد والسياق القانوني والثقافي في السؤال |

| تحيز تبسيط مفرط | تحويل قضايا معقدة إلى إجابات قصيرة قطعية | اطلب تفصيلًا وخيارات متعددة بدل إجابة واحدة |

هل يمكن تقليل التحيز تقنيًا؟ وما دور المستخدم؟

تعمل الشركات عادة على تقليل التحيز عبر تحسين البيانات والاختبارات وتحديث السياسات، لكن التحدي أن العالم نفسه غير متوازن في تمثيل المعلومات. لذلك سيظل جزء من الحل في يد المستخدم: أسئلة أفضل، وتحقيق بسيط، وعدم اعتبار أي إجابة “حكمًا نهائيًا” خصوصًا في الموضوعات التي تحتاج بيانات دقيقة.

وعندما يتعلق الأمر بالمحتوى الذي يُنشر للجمهور، يصبح من الضروري مراجعة النص بعين نقدية: هل قدمت الإجابة صورة عادلة؟ هل ذكرت حدود المعرفة؟ هل استخدمت لغة محترمة وغير تصنيفية؟ هذه المعايير لا تحمي فقط من التحيز، بل ترفع جودة المقال وتجعله مناسبًا لبيئات النشر التي تفضل المحتوى المتوازن.

الذكاء الاصطناعي أداة قوية، لكنه مرآة للبيانات والاختيارات. ومع وعي بسيط بسؤال “كيف ولماذا؟” يمكن تحويل التجربة من مجرد إجابات سريعة إلى معرفة أكثر دقة واحترامًا للسياقات المختلفة، خصوصًا للمستخدم العربي الذي يحتاج محتوى يعكس واقعه بدل استنساخ منظور واحد للعالم.